La société MICROSOFT CORPORATION, société multinationale créée en 1976 dont le siège social est situé aux États-Unis, a pour activité principale le développement et la vente de systèmes d’exploitation, de logiciels applicatifs, de matériels et de services dérivés. Elle a également une activité de conseil et de support pour l’ensemble des produits MICROSOFT. La société MICROSOFT IRELAND OPERATIONS LIMITED , est une filiale de la société MICROSOFT CORPORATION dont le siège social est situé 1, Microsoft Place, South County Business Park, Leopardstown à Dublin. La société MIOL exploite et développe le moteur de recherche Bing dans l’Espace économique européen.

Le domaine » bing.com » accessible depuis la France comptait 10 801 000 utilisateurs uniques résidant en France en septembre 2020 et le chiffre d’affaires attribuable au domaine » bing.com » en France s’est élevé à en 2020 et à en 2021. La société MICROSOFT FRANCE, filiale de la société MICROSOFT CORPORATION et société sœur de la société MIOL, est une société par actions simplifiée, immatriculée au registre du commerce et des sociétés de Nanterre sous le numéro 327733184, dont le siège social est situé 37/45, quai du Président Roosevelt, Issy-les-Moulineaux . L’objet de ce contrôle était de vérifier la conformité de tout traitement accessible à partir du domaine » bing.com » depuis un terminal situé en France à la loi n° 78-17 du 6 janvier 1978 modifiée relative à l’informatique, aux fichiers et aux libertés et au règlement 2016/679 du Parlement européen et du Conseil du 27 avril 2016 . Le 13 novembre 2020, la société MICROSOFT FRANCE a transmis des éléments de réponse à la CNIL.

Le 4 février 2021, la société MICROSOFT FRANCE a été auditionnée et a fourni des réponses aux questions posées par la délégation, relatives notamment aux relations entre les sociétés MICROSOFT FRANCE, MICROSOFT CORPORATION et MIOL, à l’organisation de la protection des données à caractère personnel au sein de MICROSOFT et à la responsabilité des traitements de publicité ciblée liés au moteur de recherche Bing. Le 16 février 2021, la société MICROSOFT FRANCE a transmis des éléments de réponse complémentaires. « – la délégation s’est rendue sur le domaine » bing.

Enfin, la délégation a cliqué sur les liens » Déclaration de confidentialité » et » Plus d’options » situés sur la fenêtre surgissante. Les 12 juillet et 31 août 2021, sur la base d’informations fournies par la société MIOL, la société MICROSOFT FRANCE a communiqué des éléments de réponse complémentaires aux demandes formulées par la délégation. Aux fins d’instruction de ces éléments, la présidente de la Commission a, le 23 décembre 2021, désigné Monsieur François PELLEGRINI en qualité de rapporteur sur le fondement de l’article 39 du décret n° 2019-536 du 29 mai 2019. Le 13 juillet 2022, le rapporteur a fait notifier à la société MIOL un rapport détaillant le manquement à l’article 82 de la loi Informatique et Libertés qu’il estimait constitué en l’espèce.

Le 9 septembre 2022, la société a produit ses observations en réponse au rapport de sanction. Le rapporteur a répondu aux observations de la société le 10 octobre 2022. Le 15 novembre 2022, la société a produit de nouvelles observations en réponse à celles du rapporteur. Par courrier du 16 novembre 2022, le rapporteur a informé le conseil de la société que l’instruction était close, en application de l’article 40, III, du décret modifié n°2019-536 du 29 mai 2019.

Par courrier du 16 novembre 2022, la société a été informée que le dossier était inscrit à l’ordre du jour de la formation restreinte du 1er décembre 2022. Le rapporteur et la société ont présenté des observations orales lors de la séance de la formation restreinte.

En défense, la société n’a pas fait d’observations sur la compétence de la CNIL

» Il s’ensuit que, pour ce qui concerne le contrôle des opérations d’accès et d’inscription d’informations dans les terminaux des utilisateurs en France d’un service de communications électroniques, même procédant d’un traitement transfrontalier, les mesures de contrôle de l’application des dispositions ayant transposé les objectifs de la directive 2002/58/CE relèvent de la compétence conférée à la CNIL par la loi du 6 janvier 1978 » .

Sur la compétence territoriale de la CNIL

Le rapporteur considère que la CNIL est territorialement compétente en application de ces dispositions dès lors que le traitement, objet de la présente procédure, consistant en des opérations d’accès ou d’inscription d’informations dans le terminal des utilisateurs résidant en France, lors de la navigation sur le site web » bing.com « , est effectué dans le » cadre des activités » de la société MICROSOFT FRANCE, qui constitue » l’établissement » sur le territoire français de la société MIOL. En défense, la société n’a pas fait d’observations sur ce point. La CJUE estime en outre qu’une société, personne morale autonome, du même groupe que le responsable de traitement, peut constituer un établissement du responsable de traitement au sens de ces dispositions . En l’occurrence, la formation restreinte relève, tout d’abord, que la société MICROSOFT FRANCE, est le siège de la filiale française de la société MICROSOFT CORPORATION.

La société MICROSOFT FRANCE a précisé qu’en l’espèce, plusieurs personnes de l’équipe en charge de la gestion de la publicité du moteur de recherche Bing, à savoir l’équipe Microsoft Advertising qui dépend de la société MIOL, sont des salariés de la société MICROSOFT FRANCE et s’occupent du marché français. En l’espèce, la formation restreinte note que les opérations d’accès ou d’inscription d’informations dans le terminal des utilisateurs situés en France, lors de l’utilisation du moteur de recherche Bing, sont intrinsèquement liées aux activités de la société MICROSOFT FRANCE. En effet, la société MIOL exploite et développe dans l’Espace économique européen le moteur de recherche Bing, sur lequel des espaces publicitaires sont achetés par des annonceurs, la promotion de ces outils publicitaires étant assurés, pour le marché français, par une partie de l’équipe Microsoft Advertising. Le rapporteur considère que la société MIOL agit en qualité de responsable du traitement en cause, en ce qu’elle détermine les finalités et les moyens du traitement consistant en des opérations d’accès ou d’inscriptions d’informations dans le terminal des utilisateurs résidant en France lors de l’utilisation du moteur de recherche Bing.

La société MICROSOFT FRANCE a précisé qu’en l’espèce, plusieurs personnes de l’équipe en charge de la gestion de la publicité du moteur de recherche Bing, à savoir l’équipe Microsoft Advertising qui dépend de la société MIOL, sont des salariés de la société MICROSOFT FRANCE et s’occupent du marché français. En l’espèce, la formation restreinte note que les opérations d’accès ou d’inscription d’informations dans le terminal des utilisateurs situés en France, lors de l’utilisation du moteur de recherche Bing, sont intrinsèquement liées aux activités de la société MICROSOFT FRANCE. En effet, la société MIOL exploite et développe dans l’Espace économique européen le moteur de recherche Bing, sur lequel des espaces publicitaires sont achetés par des annonceurs, la promotion de ces outils publicitaires étant assurés, pour le marché français, par une partie de l’équipe Microsoft Advertising. Le rapporteur considère que la société MIOL agit en qualité de responsable du traitement en cause, en ce qu’elle détermine les finalités et les moyens du traitement consistant en des opérations d’accès ou d’inscriptions d’informations dans le terminal des utilisateurs résidant en France lors de l’utilisation du moteur de recherche Bing.

La société n’a pas fait valoir d’observations sur ce point. La formation restreinte souligne que, dans son courrier du 13 novembre 2020, la société MICROSOFT FRANCE, qui communique » sur la base des informations qui ont été communiquées par Microsoft Ireland Operations Limited « , faisait état du rôle de MIOL en tant que responsable du traitement des données effectué à partir du domaine » bing.com » pour les utilisateurs de l’EEE, du Royaume-Uni et de la Suisse et précisait que MIOL exerçait une influence décisive sur les finalités et les modalités de mise en œuvre des traitements et notamment les traitements relatifs à la publicité ciblée. La formation restreinte relève enfin que ces propos ont été confirmés par la société MICROSOFT FRANCE lors de l’audition du 4 février 2021. Il résulte de ce qui précède que la société MIOL détermine les finalités et les moyens du traitement consistant en des opérations d’accès ou d’inscriptions d’informations dans le terminal des utilisateurs résidant en France, lors de l’utilisation du moteur de recherche Bing, et agit donc en qualité de responsable du traitement en cause.

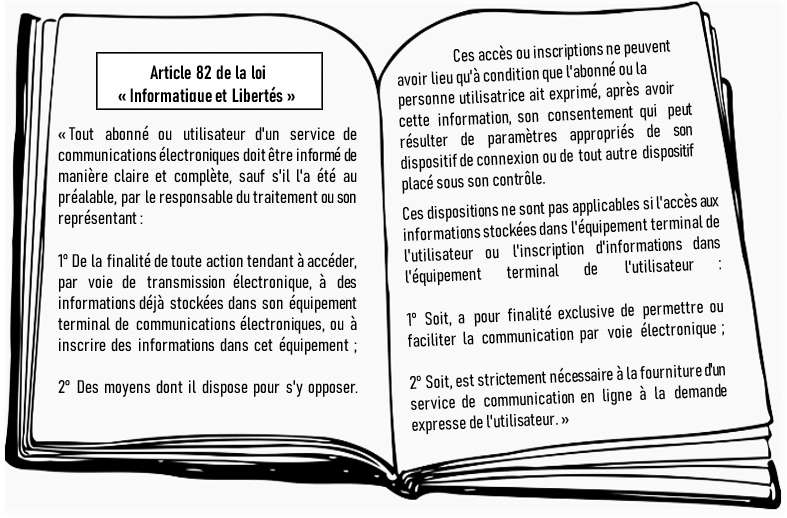

« 2° Soit, est strictement nécessaire à la fourniture d’un service de communication en ligne à la demande expresse de l’utilisateur « . La société indique que seules les finalités essentielles sont activées avant que l’utilisateur donne son consentement. La société soutient que ces finalités indissociables sont strictement nécessaires à la fourniture des services » bing.com » tels que demandés par l’utilisateur. En outre, le rapporteur précise, en réponse à l’argumentation de la société considérant la finalité de lutte contre la fraude au sens large comme une finalité essentielle exemptée de consentement, que seule la finalité de lutte contre les attaques en déni de service pourrait être exemptée de consentement.

Le rapporteur relève que les autres finalités évoquées ne relèvent pas du champ des exemptions prévues par l’article 82 de la loi Informatique et Libertés puisqu’elles n’ont pas vocation à faciliter une communication électronique et ne sont pas strictement nécessaires à la fourniture d’un service expressément demandé par l’utilisateur.

La société, dans ses dernières observations, soutient que les finalités de détection des maliciels et de lutte contre la désinformation, et la fraude publicitaire sont strictement nécessaires à la fourniture du service » bing.com « , service qui produit des résultats de recherche pertinents, fiables et sûrs. La société soutient que le terme service doit être interprété en référence aux attentes légitimes d’un utilisateur, ainsi qu’aux obligations légales du fournisseur, concernant l’intégrité, la qualité et la sécurité. La société soutient également que dans ce cas, la conformité aux exigences du RGPD serait alors supervisée par la Data Protection Commission, l’autorité de protection irlandaise, dans le cadre du guichet unique prévu par le RGPD, et non pas par la CNIL. » La formation restreinte relève à titre illustratif que la Commission précise, dans ses lignes directrices du 17 septembre 2020, que » l’utilisation d’un même traceur pour plusieurs finalités, dont certaines n’entrent pas dans le cadre de ces exemptions, nécessite de recueillir préalablement le consentement des personnes concernées, dans les conditions rappelées par les présentes lignes directrices.

À cet égard, le considérant 42 de ce Règlement prévoit que » le consentement ne devrait pas être considéré comme ayant été donné librement si la personne concernée ne dispose pas d’une véritable liberté de choix ou n’est pas en mesure de refuser ou de retirer son consentement sans subir de préjudice « . La formation restreinte rappelle que si ces instruments n’ont certes pas de caractère impératif, ils visent à interpréter les dispositions législatives applicables et à éclairer les acteurs sur la mise en place de mesures concrètes permettant de garantir le respect des dispositions légales, afin qu’ils mettent en œuvre ces mesures ou des mesures d’effet équivalent. En ce sens, il est précisé dans les lignes directrices que celles-ci » ont pour objet principal de rappeler et d’expliciter le droit applicable aux opérations de lecture et/ou d’écriture d’informations dans l’équipement terminal de communications électroniques de l’abonné ou de l’utilisateur, et notamment à l’usage des témoins de connexion « . En effet, ce principe de liberté du consentement implique que l’utilisateur bénéficie d’une » véritable liberté de choix « , comme souligné au considérant 42 du RGPD, et donc que les modalités qui lui sont proposées pour manifester ce choix ne soient pas biaisées en faveur du consentement.

À cet égard, le considérant 42 de ce Règlement prévoit que » le consentement ne devrait pas être considéré comme ayant été donné librement si la personne concernée ne dispose pas d’une véritable liberté de choix ou n’est pas en mesure de refuser ou de retirer son consentement sans subir de préjudice « . La formation restreinte rappelle que si ces instruments n’ont certes pas de caractère impératif, ils visent à interpréter les dispositions législatives applicables et à éclairer les acteurs sur la mise en place de mesures concrètes permettant de garantir le respect des dispositions légales, afin qu’ils mettent en œuvre ces mesures ou des mesures d’effet équivalent. En ce sens, il est précisé dans les lignes directrices que celles-ci » ont pour objet principal de rappeler et d’expliciter le droit applicable aux opérations de lecture et/ou d’écriture d’informations dans l’équipement terminal de communications électroniques de l’abonné ou de l’utilisateur, et notamment à l’usage des témoins de connexion « . En effet, ce principe de liberté du consentement implique que l’utilisateur bénéficie d’une » véritable liberté de choix « , comme souligné au considérant 42 du RGPD, et donc que les modalités qui lui sont proposées pour manifester ce choix ne soient pas biaisées en faveur du consentement.

« S’agissant des modalités de refus possibles, dans cette même recommandation, la Commission a préconisé » fortement que le mécanisme permettant d’exprimer un refus de consentir aux opérations de lecture et/ou d’écriture soit accessible sur le même écran et avec la même facilité que le mécanisme permettant d’exprimer un consentement. En effet, elle estime que les interfaces de recueil du consentement qui nécessitent un seul clic pour consentir au traçage tandis que plusieurs actions sont nécessaires pour » paramétrer » un refus de consentir présentent, dans la plupart des cas, le risque de biaiser le choix de l’utilisateur, qui souhaite pouvoir visualiser le site ou utiliser l’application rapidement. Par exemple, au stade du premier niveau d’information, les utilisateurs peuvent avoir le choix entre deux boutons présentés au même niveau et sur le même format, sur lesquels sont inscrits respectivement » tout accepter » et » tout refuser « , » autoriser » et » interdire « , ou » consentir » et » ne pas consentir « , ou toute autre formulation équivalente et suffisamment claire. » La Commission considère que cette modalité constitue un moyen simple et clair pour permettre à l’utilisateur d’exprimer son refus aussi facilement que son consentement « .

Le rapporteur a donc considéré que les conditions de recueil du consentement mises en œuvre par la société MIOL sur le site web » bing.com » n’étaient pas conformes aux dispositions de l’article 82 de la loi Informatique et Libertés telles qu’éclairées par l’article 4, paragraphe 11, du RGPD sur la liberté du consentement, au moment du contrôle en ligne du 11 mai 2021 et jusqu’au 29 mars 2022, date à laquelle la société a mis en place un bouton » Tout refuser « . A défaut, l’équilibre entre les modalités d’acceptation et de refus n’est pas respecté. En effet, un utilisateur d’Internet est généralement conduit à consulter de nombreux sites.

Au regard de ce qui précède, la formation restreinte considère qu’un manquement aux dispositions de l’article 82 de la loi Informatique et Libertés, interprétées à la lumière du RGPD, est constitué, dans la mesure où, au moment du contrôle en ligne du 11 mai 2021 et jusqu’à la mise en place d’un bouton » Tout refuser » le 29 mars 2022, l’utilisateur n’avait pas la possibilité de refuser les opérations de lecture et/ou d’écriture avec le même degré de simplicité qu’il avait de les accepter.

2° Une injonction de mettre en conformité le traitement avec les obligations résultant du règlement de l’article 83, paragraphe 2, du Règlement relatif aux avantages financiers obtenus du fait du manquement et à toute autre circonstance. À cet égard, la formation restreinte relève que les clients de l’équipe Microsoft Advertising pour le public français, tels que achètent des espaces publicitaires sur le moteur de recherche Bing et collaborent avec l’équipe Microsoft Advertising afin de cibler les publics locaux et ainsi proposer les publicités les plus pertinentes. La formation restreinte relève que l’affichage de publicités personnalisées à un internaute n’est possible que si la navigation de ce dernier a pu être tracée grâce à un traceur, afin de déterminer quel contenu serait le plus pertinent à afficher. La formation restreinte relève également que les comptes de Microsoft Corporation et de ses filiales qui sont publiquement disponibles démontrent que la publicité constitue l’un des modèles économiques majeurs du groupe Microsoft.

Le rapport annuel 2021 du groupe mentionne ainsi que sa marge brute a augmenté de 10 % en 2021 grâce, notamment, au secteur de la publicité. La mise en conformité devait avoir lieu pour le 1er avril 2021. Des centaines de milliers d’acteurs, des plus petits sites aux plus importants, se sont mis en conformité et ont introduit sur leur interface de recueil du consentement un bouton » Refuser » ou » Continuer sans accepter « . La formation restreinte note également qu’avant le contrôle en ligne du 11 mai 2021, un premier contrôle en ligne avait été réalisé par la délégation le 29 septembre 2020, et qu’une audition de la société MICROSOFT FRANCE avait été organisée le 4 février 2021 avec la délégation.

La formation restreinte relève pourtant que ce n’est que le 29 mars 2022 que la société a choisi d’insérer un bouton » Tout refuser « , suite à la désignation d’un rapporteur par la présidente de la Commission. En dernier lieu, la formation restreinte rappelle qu’en application des dispositions de l’article 20, paragraphe III, de la loi Informatique et Libertés, la société MIOL encourt une sanction financière d’un montant maximum de 2% de son chiffre d’affaires ou de 10 millions d’euros, le montant le plus élevé étant retenu. Compte tenu du chiffre d’affaires de la société s’élevant à en 2021, le montant maximal de l’amende encourue en l’espèce s’élève donc à plus de . Dès lors, au regard de la responsabilité de la société, de ses capacités financières et des critères pertinents de l’article 83, paragraphe 2, du Règlement évoqués ci-avant, la formation restreinte estime qu’une amende de soixante millions d’euros à l’encontre de la société MICROSOFT IRELAND OPERATIONS LIMITED apparaît justifiée.

La société soutient que le prononcé d’une injonction n’est pas nécessaire. Elle estime dès lors nécessaire le prononcé d’une injonction afin que la société se mette en conformité avec les obligations applicables en la matière. En second lieu, la formation restreinte rappelle que le montant de l’astreinte doit être à la fois proportionné à la gravité des manquements commis et adapté aux capacités financières du responsable de traitement. Au regard de ces éléments, la formation restreinte considère comme justifié le prononcé d’une injonction assortie d’une astreinte d’un montant de soixante mille euros par jour de retard et liquidable à l’issue d’un délai de trois mois.

La société conteste la proposition du rapporteur de rendre publique la présente décision. Elle considère que la publication de la sanction entraînerait des conséquences importantes et disproportionnées en termes d’image et de réputation. Pour justifier cette demande de publicité, le rapporteur invoque notamment le nombre de personnes concernées et la nature du manquement constitué en l’espèce. La formation restreinte considère que la publicité de la présente décision se justifie au regard de la gravité des manquements en cause, de la portée du traitement et du nombre de personnes concernées.

La formation restreinte relève que cette mesure permettra d’alerter les utilisateurs français du moteur de recherche Bing de la caractérisation du manquement à l’article 82 de la loi Informatique et Libertés dans ses différentes branches et du prononcé d’une injonction pour y remédier. Enfin, la mesure est proportionnée dès lors que la décision n’identifiera plus nommément la société à l’expiration d’un délai de deux ans à compter de sa publication. » prononcer à l’encontre de la société MICROSOFT IRELAND OPERATIONS LIMITED une injonction de recueillir le consentement des utilisateurs lors de leur arrivée sur le site web » bing.

A.R

« Les personnes physiques ou morales qui assurent, même à titre gratuit, pour mise à disposition du public par des services de communication au public en ligne, le stockage de signaux, d’écrits, d’images, de sons ou de messages de toute nature fournis par des destinataires de ces services ne peuvent pas voir leur responsabilité civile engagée du fait des activités ou des informations stockées à la demande d’un destinataire de ces services si elles n’avaient pas effectivement connaissance de leur caractère illicite ou de faits et circonstances faisant apparaître ce caractère ou si, dès le moment où elles en ont eu cette connaissance, elles ont agi promptement pour retirer ces données ou en rendre l’accès impossible. »[4]

« Les personnes physiques ou morales qui assurent, même à titre gratuit, pour mise à disposition du public par des services de communication au public en ligne, le stockage de signaux, d’écrits, d’images, de sons ou de messages de toute nature fournis par des destinataires de ces services ne peuvent pas voir leur responsabilité civile engagée du fait des activités ou des informations stockées à la demande d’un destinataire de ces services si elles n’avaient pas effectivement connaissance de leur caractère illicite ou de faits et circonstances faisant apparaître ce caractère ou si, dès le moment où elles en ont eu cette connaissance, elles ont agi promptement pour retirer ces données ou en rendre l’accès impossible. »[4]

Il y a deux ans, Noyb a déposé une plainte GDPR contre le courtier en données de crédit KSV 1870. L’agence autrichienne d’évaluation du crédit stockait des données non sollicitées de personnes jusqu’alors inconnues qui exerçaient leur droit légal d’accéder à leurs données. Aujourd’hui, l’autorité autrichienne de protection des données (DSB) a publié sa décision sur cette affaire : l’agence d’évaluation du crédit ne peut pas collecter de données par le biais de demandes d’accès à des registres d’état civil.

Il y a deux ans, Noyb a déposé une plainte GDPR contre le courtier en données de crédit KSV 1870. L’agence autrichienne d’évaluation du crédit stockait des données non sollicitées de personnes jusqu’alors inconnues qui exerçaient leur droit légal d’accéder à leurs données. Aujourd’hui, l’autorité autrichienne de protection des données (DSB) a publié sa décision sur cette affaire : l’agence d’évaluation du crédit ne peut pas collecter de données par le biais de demandes d’accès à des registres d’état civil.

Pour la CJUE, cela ne fait aucun doute. Selon elle, cette mesure

Pour la CJUE, cela ne fait aucun doute. Selon elle, cette mesure

Là se situe le point bloquant de cette mesure pour la CJUE.

Là se situe le point bloquant de cette mesure pour la CJUE. La France s’est dotée de lois similaires. Sur le même principe qu’en Lituanie, une autorité administrative indépendante est investie de la mission de contrôler l’application des règles en matière de prévention des conflits d’intérêts et de lutte contre la corruption : la Haute Autorité pour la transparence de la vie publique

La France s’est dotée de lois similaires. Sur le même principe qu’en Lituanie, une autorité administrative indépendante est investie de la mission de contrôler l’application des règles en matière de prévention des conflits d’intérêts et de lutte contre la corruption : la Haute Autorité pour la transparence de la vie publique Mais quelle a donc a été la

Mais quelle a donc a été la  Vous êtes

Vous êtes

Pire encore, alors que les internautes doivent pouvoir retirer aussi facilement leur consentement à cette finalité de ciblage publicitaire que le donner, il était particulièrement compliqué pour les usagers d’iPhones de désactiver cette configuration pré-cochée. Ceux-ci devaient se perdre dans les méandres des fonctionnalités de leur portable pour y arriver.

Pire encore, alors que les internautes doivent pouvoir retirer aussi facilement leur consentement à cette finalité de ciblage publicitaire que le donner, il était particulièrement compliqué pour les usagers d’iPhones de désactiver cette configuration pré-cochée. Ceux-ci devaient se perdre dans les méandres des fonctionnalités de leur portable pour y arriver. Lorsque les tribunaux nationaux s’interrogent durant un procès sur le sens à donner à une législation européenne, ils peuvent adresser à la Cour de Justice de l’Union Européenne (CJUE) une question

Lorsque les tribunaux nationaux s’interrogent durant un procès sur le sens à donner à une législation européenne, ils peuvent adresser à la Cour de Justice de l’Union Européenne (CJUE) une question

La société MICROSOFT FRANCE a précisé qu’en l’espèce, plusieurs personnes de l’équipe en charge de la gestion de la publicité du moteur de recherche Bing, à savoir l’équipe Microsoft Advertising qui dépend de la société MIOL, sont des salariés de la société MICROSOFT FRANCE et s’occupent du marché français. En l’espèce, la formation restreinte note que les opérations d’accès ou d’inscription d’informations dans le terminal des utilisateurs situés en France, lors de l’utilisation du moteur de recherche Bing, sont intrinsèquement liées aux activités de la société MICROSOFT FRANCE. En effet, la société MIOL exploite et développe dans l’Espace économique européen le moteur de recherche Bing, sur lequel des espaces publicitaires sont achetés par des annonceurs, la promotion de ces outils publicitaires étant assurés, pour le marché français, par une partie de l’équipe Microsoft Advertising. Le rapporteur considère que la société MIOL agit en qualité de responsable du traitement en cause, en ce qu’elle détermine les finalités et les moyens du traitement consistant en des opérations d’accès ou d’inscriptions d’informations dans le terminal des utilisateurs résidant en France lors de l’utilisation du moteur de recherche Bing.

La société MICROSOFT FRANCE a précisé qu’en l’espèce, plusieurs personnes de l’équipe en charge de la gestion de la publicité du moteur de recherche Bing, à savoir l’équipe Microsoft Advertising qui dépend de la société MIOL, sont des salariés de la société MICROSOFT FRANCE et s’occupent du marché français. En l’espèce, la formation restreinte note que les opérations d’accès ou d’inscription d’informations dans le terminal des utilisateurs situés en France, lors de l’utilisation du moteur de recherche Bing, sont intrinsèquement liées aux activités de la société MICROSOFT FRANCE. En effet, la société MIOL exploite et développe dans l’Espace économique européen le moteur de recherche Bing, sur lequel des espaces publicitaires sont achetés par des annonceurs, la promotion de ces outils publicitaires étant assurés, pour le marché français, par une partie de l’équipe Microsoft Advertising. Le rapporteur considère que la société MIOL agit en qualité de responsable du traitement en cause, en ce qu’elle détermine les finalités et les moyens du traitement consistant en des opérations d’accès ou d’inscriptions d’informations dans le terminal des utilisateurs résidant en France lors de l’utilisation du moteur de recherche Bing. À cet égard, le considérant 42 de ce Règlement prévoit que » le consentement ne devrait pas être considéré comme ayant été donné librement si la personne concernée ne dispose pas d’une véritable liberté de choix ou n’est pas en mesure de refuser ou de retirer son consentement sans subir de préjudice « . La formation restreinte rappelle que si ces instruments n’ont certes pas de caractère impératif, ils visent à interpréter les dispositions législatives applicables et à éclairer les acteurs sur la mise en place de mesures concrètes permettant de garantir le respect des dispositions légales, afin qu’ils mettent en œuvre ces mesures ou des mesures d’effet équivalent. En ce sens, il est précisé dans les lignes directrices que celles-ci » ont pour objet principal de rappeler et d’expliciter le droit applicable aux opérations de lecture et/ou d’écriture d’informations dans l’équipement terminal de communications électroniques de l’abonné ou de l’utilisateur, et notamment à l’usage des témoins de connexion « . En effet, ce principe de liberté du consentement implique que l’utilisateur bénéficie d’une » véritable liberté de choix « , comme souligné au considérant 42 du RGPD, et donc que les modalités qui lui sont proposées pour manifester ce choix ne soient pas biaisées en faveur du consentement.

À cet égard, le considérant 42 de ce Règlement prévoit que » le consentement ne devrait pas être considéré comme ayant été donné librement si la personne concernée ne dispose pas d’une véritable liberté de choix ou n’est pas en mesure de refuser ou de retirer son consentement sans subir de préjudice « . La formation restreinte rappelle que si ces instruments n’ont certes pas de caractère impératif, ils visent à interpréter les dispositions législatives applicables et à éclairer les acteurs sur la mise en place de mesures concrètes permettant de garantir le respect des dispositions légales, afin qu’ils mettent en œuvre ces mesures ou des mesures d’effet équivalent. En ce sens, il est précisé dans les lignes directrices que celles-ci » ont pour objet principal de rappeler et d’expliciter le droit applicable aux opérations de lecture et/ou d’écriture d’informations dans l’équipement terminal de communications électroniques de l’abonné ou de l’utilisateur, et notamment à l’usage des témoins de connexion « . En effet, ce principe de liberté du consentement implique que l’utilisateur bénéficie d’une » véritable liberté de choix « , comme souligné au considérant 42 du RGPD, et donc que les modalités qui lui sont proposées pour manifester ce choix ne soient pas biaisées en faveur du consentement.

Que sont les règles d’entreprise contraignantes ou BCR ?

Que sont les règles d’entreprise contraignantes ou BCR ?