DSA DMA stop ou encore ?

L’Union Européenne donne le « la » en matière de réglementation des services et marchés numériques

La digitalisation de notre économie et la dématérialisation de nos relations humaines se sont démocratisées au point que nous en oublierions presque l’ampleur du phénomène.

Des sites de vente en ligne à l’omniprésence des publicités sur Internet, en passant par les applications de paiement à distance et les réseaux sociaux : ces fonctionnalités – un temps regardées comme de véritables innovations – se sont depuis largement banalisées.

Or, une fois de plus, le monde juridique peine à suivre le rythme de ces progrès technologiques.

Si les législateurs ne peuvent pas aller plus vite que la musique, les textes européens en vigueur en la matière s’avèrent anachroniques. De fait, les règles applicables aujourd’hui trouvent encore leur source dans une directive du 08 juin 2000 dite « Directive sur le commerce électronique »[1] & [2]…

Il est donc temps de changer de disque ! La Commission européenne a proposé en décembre 2020 deux résolutions destinées à moderniser et à harmoniser les normes actuelles régissant ce domaine.

Elles ont pour ambition de confirmer les principes essentiels de la directive sur le « e-commerce », tout en la réformant en profondeur afin de l’adapter aux évolutions économiques et sociétales intervenues depuis les années 2000.

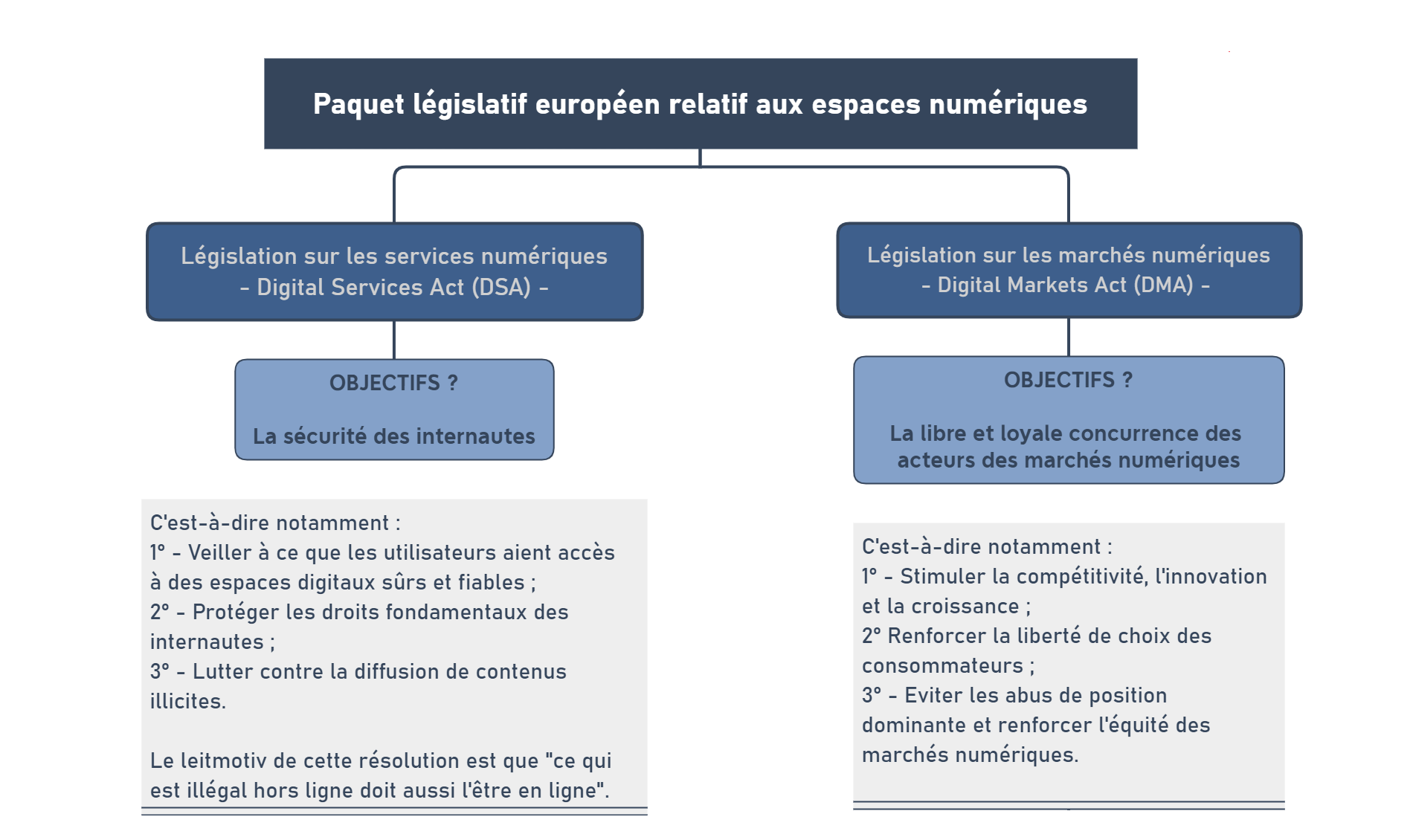

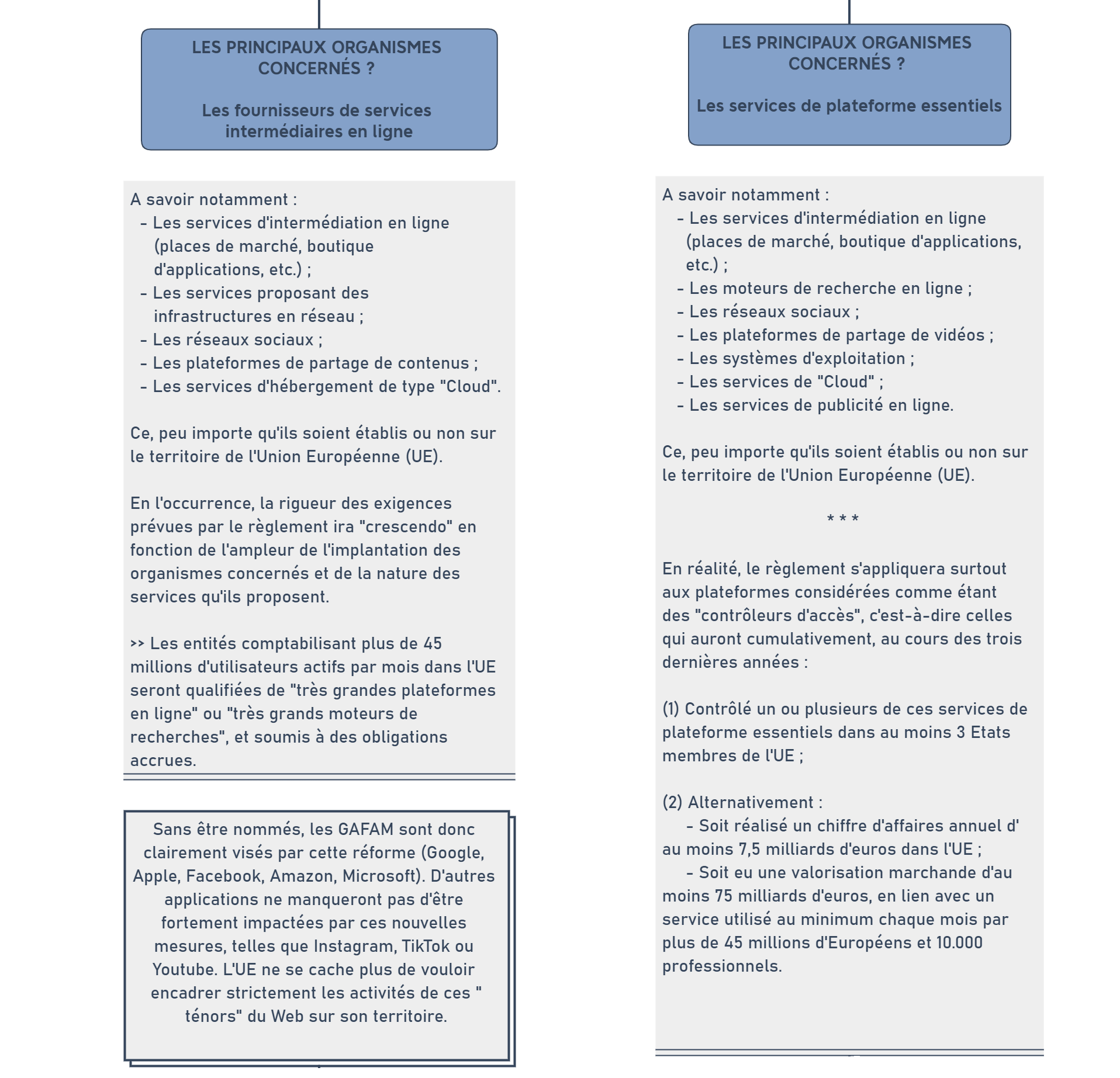

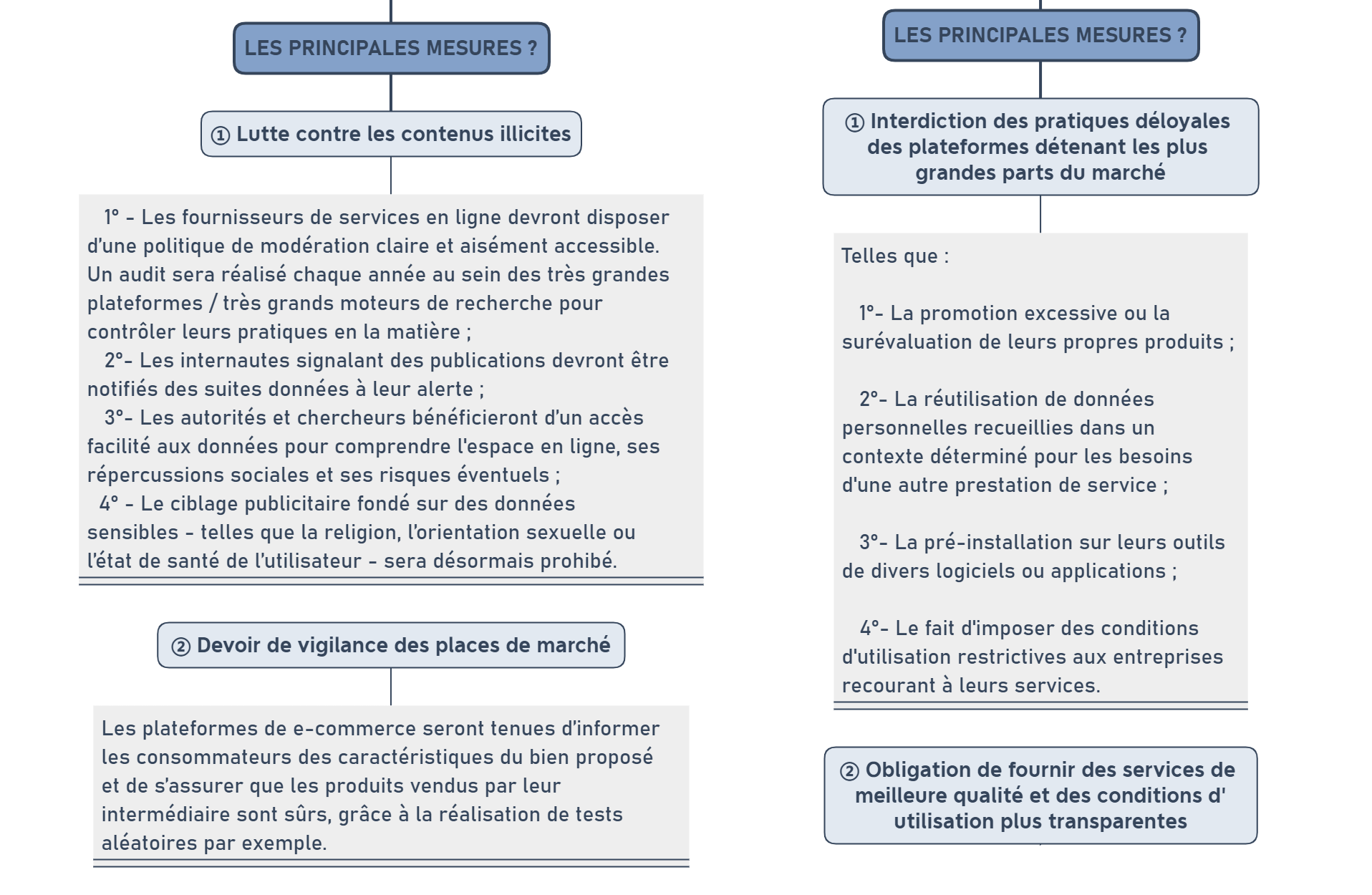

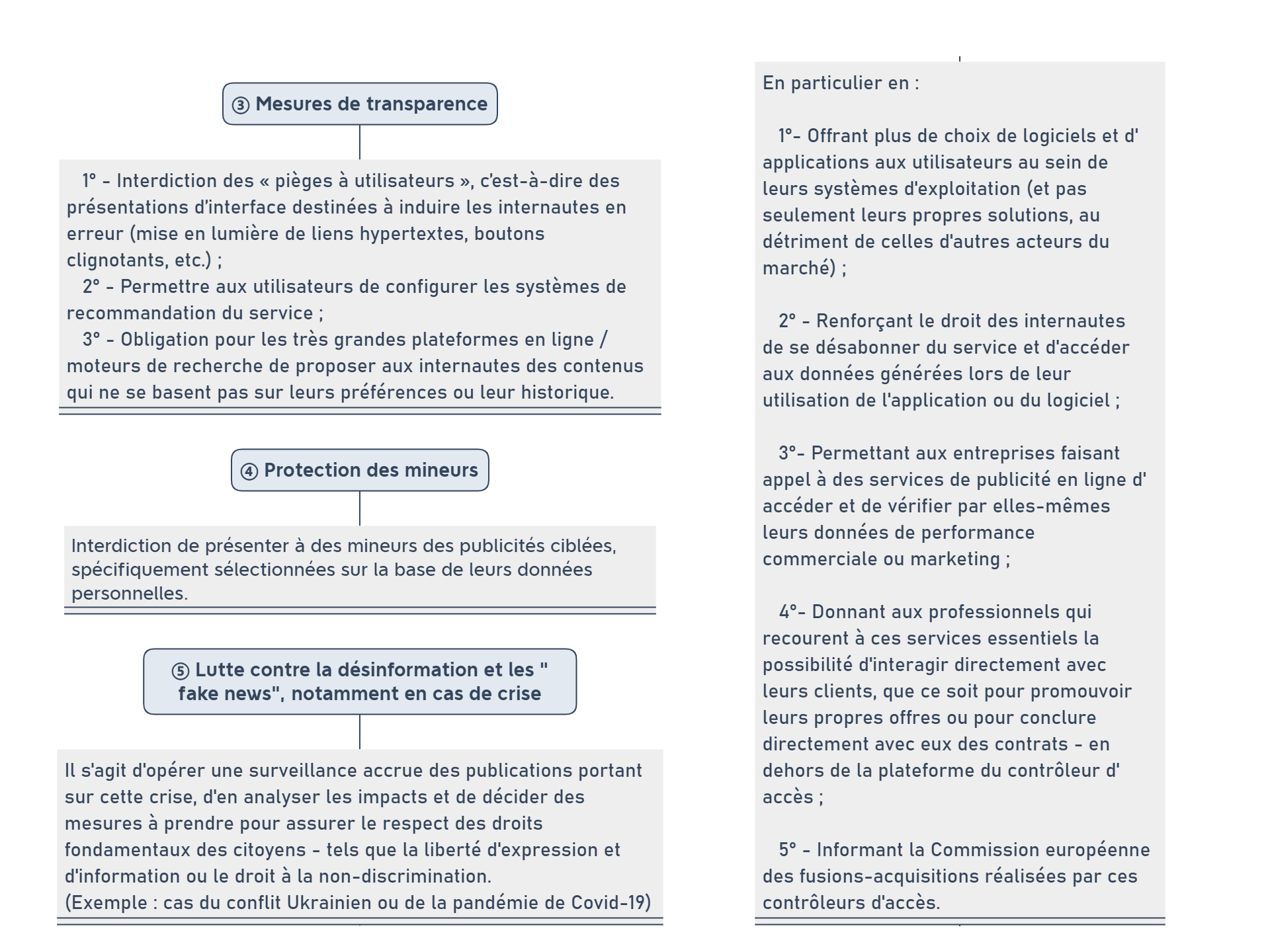

Ce « paquet législatif » est composé de deux propositions complémentaires, à savoir :

- Une législation sur les services numériques, aussi connue sous le nom de « Digital Services Act » (DSA).

- Une législation sur les marchés numériques, appelée également « Digital Markets Act » (DMA).

Ces textes ne sont d’ailleurs pas remis en cause par l’adoption du paquet législatif européen sur les services et marchés numériques.

Le 24 mars 2022, le Conseil et le Parlement européens se sont accordés sur les mesures contenues dans la proposition de législation sur les marchés numériques.

Le 24 mars 2022, le Conseil et le Parlement européens se sont accordés sur les mesures contenues dans la proposition de législation sur les marchés numériques.

Puis, le 23 avril 2022, ces institutions ont cette fois donné sans tambour ni trompette leur accord politique provisoire pour la législation sur les services numériques.

Comment ce paquet législatif entend-t-il orchestrer les espaces numériques utilisés par les citoyens européens ?

Encore un petit bémol…

Nous attirons votre attention sur le fait que, même si les risques sont faibles, ces mesures peuvent encore être modifiées !

Ces législations n’ont en effet pas été définitivement adoptées. Les accords provisoires intervenus les concernant doivent encore être approuvés par le Conseil et le Parlement européen.

A l’issue de ce vote, le règlement sur les marchés numériques devrait être mis en œuvre dans un délai de six mois après son entrée en vigueur.

Quant à la proposition sur les services numériques, l’approbation du « Comité des représentants permanents » est requise avant son adoption formelle. Il est prévu que ce texte entre en vigueur 20 jours après sa publication au Journal officiel de l’Union Européenne. Il aura ensuite vocation à s’appliquer dans les quinze mois suivants, ou à compter du 1er janvier 2024, la date la plus tardive étant retenue[3].

La proposition de règlement sur les services numériques a vocation à s’appliquer en complément et parallèlement au Règlement Général sur la Protection des Données (RGPD).

Aux termes de l’article 1(5) de la Proposition de règlement formulée en décembre 2020, ce texte s’entend également sans préjudice des règles établies par les actes suivants :

« (a) la directive 2000/31/CE [sur le commerce électronique] ;

(b) la directive 2010/13/CE [sur les services de médias audiovisuels] ;

(c) le droit de l’Union sur le droit d’auteur et les droits voisins ;

(d) le règlement (UE) …/… relatif à la prévention de la diffusion de contenus à caractère terroriste en ligne [une fois adopté] ;

(e) le règlement (UE) …/… relatif aux injonctions européennes de production et de conservation de preuves électroniques en matière pénale, et la directive (UE) …/… établissant des règles harmonisées concernant la désignation de représentants légaux aux fins de la collecte de preuves en matière pénale [une fois adoptés] ;

(f) le règlement (UE) 2019/1148 ;

(g) le règlement (UE) 2019/1150 [promouvant l’équité et la transparence pour les entreprises utilisatrices de services d’intermédiation en ligne] ;

(h) le droit de l’Union en matière de protection des consommateurs et de sécurité des produits, notamment le règlement (UE) 2017/2394 ».

Le champ d’application du règlement sur les marchés numériques est lui aussi particulièrement large, puisqu’il n’aspire pas à remettre en cause les articles 101 et 102 du Traité sur le Fonctionnement de l’Union Européenne en matière de lutte contre les pratiques anti-concurrentielles, ou toute autre législation nationale en vigueur à ce sujet.

La directive (UE) 2018/1972 du 11 décembre 2018 établissant le Code des communications électroniques européen n’est pas davantage abrogée du fait de l’adoption de ce paquet législatif.

Loin d’assurer une protection accrue des utilisateurs de services en ligne, cette superposition de réglementations risque à l’inverse d’être source de confusion.

Les dispositions contradictoires de ces différentes législations offriront autant de failles dans lesquelles pourront s’engouffrer les plateformes de réseaux sociaux et les moteurs de recherche pour échapper à leur responsabilité, au détriment des internautes.

L’encadrement à outrance de ces mesures, que l’Union Européenne souhaiterait être réglées comme du papier à musique, pourrait bien tourner en véritable cacophonie juridique !

[1] « Directive 2000/31/CE du Parlement européen et du Conseil du 8 juin 2000 relative à certains aspects juridiques des services de la société de l’information, et notamment du commerce électronique, dans le marché intérieur ».

[2] L’Union Européenne avait toutefois déjà commencé à encadrer progressivement certains secteurs du marché numérique, notamment à travers le « Règlement 2019/1150 du 20 juin 2019 promouvant l’équité et la transparence pour les entreprises utilisatrices de services d’intermédiation en ligne », ou encore la « Directive 2015/2366 du 25 novembre 2015 concernant les services de paiement en ligne ».

[3] Étant précisé que les obligations incombant aux très grandes plateformes en ligne et très grands moteurs de recherche s’appliqueront à l’issue du 4ème mois à partir de la date à laquelle ils auront été désignés comme tels.

L.H

Depuis plus de 15 ans, RGPD-Experts accompagne les organismes dans leurs démarches de conformité grâce à son expérience et sa méthodologie éprouvée. Avec ses outils métiers, vous suivrez et démontrerez votre conformité à l’autorité de contrôle. Notre mission : simplifier le développement de vos activités en toute sérénité et accroître votre chiffre d’affaires.

Selon un sondage IFOP de 2017, 83% des Français auraient déjà entendu parler des algorithmes[2]. Toutefois, la moitié des personnes interrogées reconnaissait ne pas comprendre précisément en quoi consistent ces programmes. Pire, 64% d’entre elles s’avouaient inquiètes du développement de ces technologies.

Selon un sondage IFOP de 2017, 83% des Français auraient déjà entendu parler des algorithmes[2]. Toutefois, la moitié des personnes interrogées reconnaissait ne pas comprendre précisément en quoi consistent ces programmes. Pire, 64% d’entre elles s’avouaient inquiètes du développement de ces technologies. A ce jour, aucune définition officielle n’a été adoptée pour déterminer ce qu’englobe le terme d’ « Intelligence Artificielle ». Il est généralement entendu comme un domaine de la science tendant à permettre à des appareils électroniques de faire ce dont l’homme est capable moyennant une certaine intelligence.

A ce jour, aucune définition officielle n’a été adoptée pour déterminer ce qu’englobe le terme d’ « Intelligence Artificielle ». Il est généralement entendu comme un domaine de la science tendant à permettre à des appareils électroniques de faire ce dont l’homme est capable moyennant une certaine intelligence.

Afin de réaliser la tâche qui lui a été attribuée, la machine se voit d’un procédé automatisé reposant sur des algorithmes. Cette technique lui permet comme par magie, ou plutôt par l’application de règles mathématiques préalablement définies (des “modèles d’IA”), de générer une déduction ou une prédiction.

Afin de réaliser la tâche qui lui a été attribuée, la machine se voit d’un procédé automatisé reposant sur des algorithmes. Cette technique lui permet comme par magie, ou plutôt par l’application de règles mathématiques préalablement définies (des “modèles d’IA”), de générer une déduction ou une prédiction. Afin de ne pas vous faire mener à la baguette, vous pouvez enfin exercer les droits qui vous sont reconnus pour conserver la maitrise de vos données personnelles, tel que votre droit d’information sur les caractéristiques principales de ces traitements de données.

Afin de ne pas vous faire mener à la baguette, vous pouvez enfin exercer les droits qui vous sont reconnus pour conserver la maitrise de vos données personnelles, tel que votre droit d’information sur les caractéristiques principales de ces traitements de données.

Plus de 120 ans après la création du cinéma par les frères Lumière, un tout autre film se joue derrière les écrans de nombreux organismes français. Le recours aux caméras de surveillance s’est massivement répandu, voire banalisé au sein des entreprises. Commerces, lieux de stockage, zones industrielles : aucun angle mort n’est oublié.

Plus de 120 ans après la création du cinéma par les frères Lumière, un tout autre film se joue derrière les écrans de nombreux organismes français. Le recours aux caméras de surveillance s’est massivement répandu, voire banalisé au sein des entreprises. Commerces, lieux de stockage, zones industrielles : aucun angle mort n’est oublié. ZOOM sur les règles à respecter lors de l’installation de systèmes de vidéosurveillance

ZOOM sur les règles à respecter lors de l’installation de systèmes de vidéosurveillance

FOCUS sur la valeur probante des enregistrements obtenus en violation de ces règles

FOCUS sur la valeur probante des enregistrements obtenus en violation de ces règles GROS PLAN sur les limites à cette prétendue irrecevabilité

GROS PLAN sur les limites à cette prétendue irrecevabilité CLAP DE FIN

CLAP DE FIN Depuis plus de 15 ans,

Depuis plus de 15 ans,